8 erreurs SEO technique à corriger d'urgence

Mansour Chamaev9 min de lectureMis à jour le 7 avril 2026

Mansour Chamaev9 min de lectureMis à jour le 7 avril 20268 erreurs de SEO technique à corriger : les images non optimisées causent 80 % des lenteurs. Diagnostic complet et solutions pour retrouver vos positions Google.

Vous avez écrit du bon contenu. Vous avez ciblé les bons mots-clés. Vous avez même fait du maillage interne. Mais votre site reste introuvable sur Google. Frustrant, non ?

Le problème est souvent invisible à l'œil nu. Il se cache dans le code, la configuration du serveur ou la structure technique de votre site. C'est le SEO technique — et c'est la fondation sur laquelle tout le reste repose.

On voit ces erreurs sur des dizaines de sites à Strasbourg et en Alsace. Voici les 8 plus courantes et comment les résoudre.

Points clés :

- Les images non optimisées sont la cause n°1 de lenteur dans 80 % des cas — la conversion en WebP/AVIF est le premier geste

- Un robots.txt mal configuré après une refonte peut rendre votre site invisible pendant des mois sans que vous le sachiez

- Des URLs accessibles en HTTP, HTTPS, avec et sans www diluent votre autorité SEO par 4 sans redirections 301

- Le LCP doit rester sous 2,5 secondes, l'INP sous 200ms et le CLS sous 0,1 pour satisfaire les critères Google

1. Pourquoi votre site est-il trop lent pour Google ?

Les Core Web Vitals sont un facteur de classement Google depuis 2021. Trois seuils à respecter : LCP sous 2,5 secondes, INP sous 200ms, CLS sous 0,1. La cause n°1 de lenteur dans 80 % des cas : les images non optimisées. La conversion en WebP/AVIF et le lazy loading sont les deux gestes qui font la plus grande différence.

C'est l'erreur n°1. Et la plus impactante. Google utilise les Core Web Vitals comme facteur de classement depuis 2021. Les trois métriques clés :

| Métrique | Mesure | Seuil acceptable |

|---|---|---|

| LCP (Largest Contentful Paint) | Temps d'affichage du plus gros élément | < 2,5s |

| INP (Interaction to Next Paint) | Réactivité aux interactions | < 200ms |

| CLS (Cumulative Layout Shift) | Stabilité visuelle | < 0,1 |

On a détaillé l'impact de la vitesse sur votre business dans notre article sur le temps de chargement et la perte de clients. Les chiffres sont sans appel : au-delà de 3 secondes, vous perdez plus de la moitié de vos visiteurs.

Les causes habituelles :

- Images non optimisées (la cause n°1 dans 80 % des cas)

- JavaScript trop lourd ou bloquant le rendu

- Hébergement mutualisé bas de gamme

- Absence de cache

- Polices web mal chargées

Comment corriger :

- Compressez et convertissez vos images en WebP/AVIF

- Utilisez le lazy loading pour les images hors écran

- Minifiez et différez le chargement des scripts non critiques

- Passez à un hébergement performant (Vercel, Netlify, hébergeur dédié)

- Préchargez les polices critiques avec

font-display: swap

2. Pas de sitemap XML (ou un sitemap cassé)

Le sitemap XML, c'est la carte routière de votre site pour Google. Sans lui, Google doit découvrir vos pages par lui-même en suivant les liens. Avec un sitemap, vous lui dites explicitement "voici toutes mes pages, indexe-les".

Les erreurs courantes :

- Pas de sitemap du tout

- Un sitemap qui liste des pages en erreur 404

- Un sitemap non déclaré dans Google Search Console

- Un sitemap non référencé dans robots.txt

- Un sitemap qui ne se met pas à jour automatiquement

La bonne pratique : Un sitemap dynamique qui se régénère automatiquement à chaque ajout/modification de page, soumis à Google Search Console et référencé dans votre robots.txt.

3. Votre robots.txt bloque-t-il Google sans que vous le sachiez ?

Le fichier robots.txt dit aux moteurs de recherche ce qu'ils peuvent et ne peuvent pas explorer. Un robots.txt mal configuré peut bloquer Google sur des pages essentielles.

L'erreur classique : Après une refonte ou un déploiement, le robots.txt de dev (Disallow: /) reste en place. Résultat : Google ne peut plus accéder à aucune page.

On a vu ce cas chez un client à Strasbourg. Son site était invisible sur Google depuis 3 mois après une refonte. La cause ? Une seule ligne dans robots.txt. Trois mois de trafic perdus.

Vérification : Allez sur votredomaine.fr/robots.txt et vérifiez qu'il n'y a pas de Disallow: / global. Utilisez aussi l'outil de test robots.txt dans Google Search Console.

4. Vos balises canoniques diluent-elles votre autorité SEO ?

Si votre page est accessible via HTTP, HTTPS, avec et sans www, Google voit potentiellement 4 pages différentes avec le même contenu. Votre autorité SEO est diluée par 4. La solution : des redirections 301 vers une URL canonique unique et une balise <link rel="canonical"> sur chaque page pointant vers la version officielle.

La balise canonical (<link rel="canonical">) indique à Google quelle est la version "officielle" d'une page. C'est essentiel pour éviter le contenu dupliqué.

Les problèmes fréquents :

- Pages accessibles en HTTP et HTTPS sans redirection (Google voit deux pages)

- URLs avec et sans trailing slash (

/servicesvs/services/) - Pages avec paramètres de tri/filtrage non canonicalisées

- Canonical qui pointe vers une page en 404

Exemple : Si votre page est accessible via http://site.fr/services, https://site.fr/services, https://www.site.fr/services et https://site.fr/services/ — Google voit potentiellement 4 pages différentes avec le même contenu. Votre "autorité" SEO est diluée par 4.

La solution : Des redirections 301 vers l'URL canonique unique + une balise canonical sur chaque page.

5. Les erreurs d'indexation (noindex oublié)

Comme on l'expliquait dans pourquoi votre site n'apparaît pas sur Google, une balise noindex oubliée peut rendre des pages invisibles.

Les cas courants :

- Le

noindexde l'environnement de développement qui reste en production - Des pages de catégories ou de tags indexées inutilement (cannibalisent vos pages principales)

- Des pages utiles marquées

noindexpar erreur - L'inverse : des pages inutiles (CGV, mentions légales) qui cannibalisent du crawl budget

Comment vérifier : Dans Google Search Console → Pages → voir les raisons d'exclusion. Vous y trouverez les pages bloquées par noindex, exclues par robots.txt ou en erreur.

6. Votre maillage interne guide-t-il Google ou le perd-il ?

Le maillage interne, ce n'est pas juste ajouter des liens au hasard. C'est une architecture qui guide Google (et vos visiteurs) vers vos pages les plus importantes.

Les erreurs :

- Des pages importantes à plus de 3 clics de la homepage

- Des pages orphelines (aucun lien interne n'y mène)

- Trop de liens dans le menu de navigation (100+ liens dans un mega-menu)

- Des ancres de lien génériques ("cliquez ici", "en savoir plus")

La bonne approche :

- Vos pages de service principales doivent être à 1-2 clics de l'accueil

- Chaque page doit avoir au moins 2-3 liens internes entrants

- Les ancres doivent être descriptives ("nos tarifs de création de site" vs "cliquez ici")

- Le blog doit faire office de hub de maillage vers vos pages de service

C'est ce qu'on pratique dans nos articles : chaque fois qu'un sujet est lié à un service ou un autre article, on crée le lien. Naturellement.

7. Comment les redirections en chaîne sabotent-elles votre SEO ?

Quand vous changez l'URL d'une page, vous créez une redirection 301 de l'ancienne vers la nouvelle. C'est bien. Mais quand vous refaites ça plusieurs fois, vous créez des chaînes :

ancienne-url → nouvelle-url → encore-plus-nouvelle-url → url-finale

Chaque redirection ajoute du temps de chargement et dilue un peu le "jus SEO" transmis. Au bout de 3-4 redirections en chaîne, Google peut arrêter de suivre.

La solution : Mettez à jour les redirections pour qu'elles pointent toutes directement vers l'URL finale. Lors d'une refonte, cartographiez toutes les anciennes URLs et créez des redirections directes.

8. Les données structurées manquantes ou invalides

Les données structurées schema.org en JSON-LD génèrent des résultats enrichis dans Google (FAQ, avis, prix) qui augmentent considérablement le taux de clic. Les schemas essentiels souvent absents : LocalBusiness et Service sur les pages de service, FAQ pour les questions fréquentes, Organization sur la page d'accueil et BreadcrumbList pour la navigation.

Les données structurées (schema.org en JSON-LD) aident Google à comprendre le contenu de vos pages. Elles peuvent générer des résultats enrichis (FAQ, avis, prix, etc.) qui augmentent considérablement votre taux de clic dans les résultats de recherche.

Ce qui manque souvent :

- Aucun schema sur les pages de service (LocalBusiness, Service, FAQ)

- Des schémas invalides (testez sur le Rich Results Test de Google)

- Pas de schema Organization sur la page d'accueil

- Pas de schema BreadcrumbList pour la navigation

L'impact : Un résultat Google avec des FAQ, des étoiles d'avis ou des prix affichés prend plus de place et attire plus de clics qu'un résultat classique. C'est un avantage concurrentiel direct, surtout pour le référencement local.

Comment auditer le SEO technique de votre site ?

Vous pouvez vérifier une bonne partie de ces points vous-même :

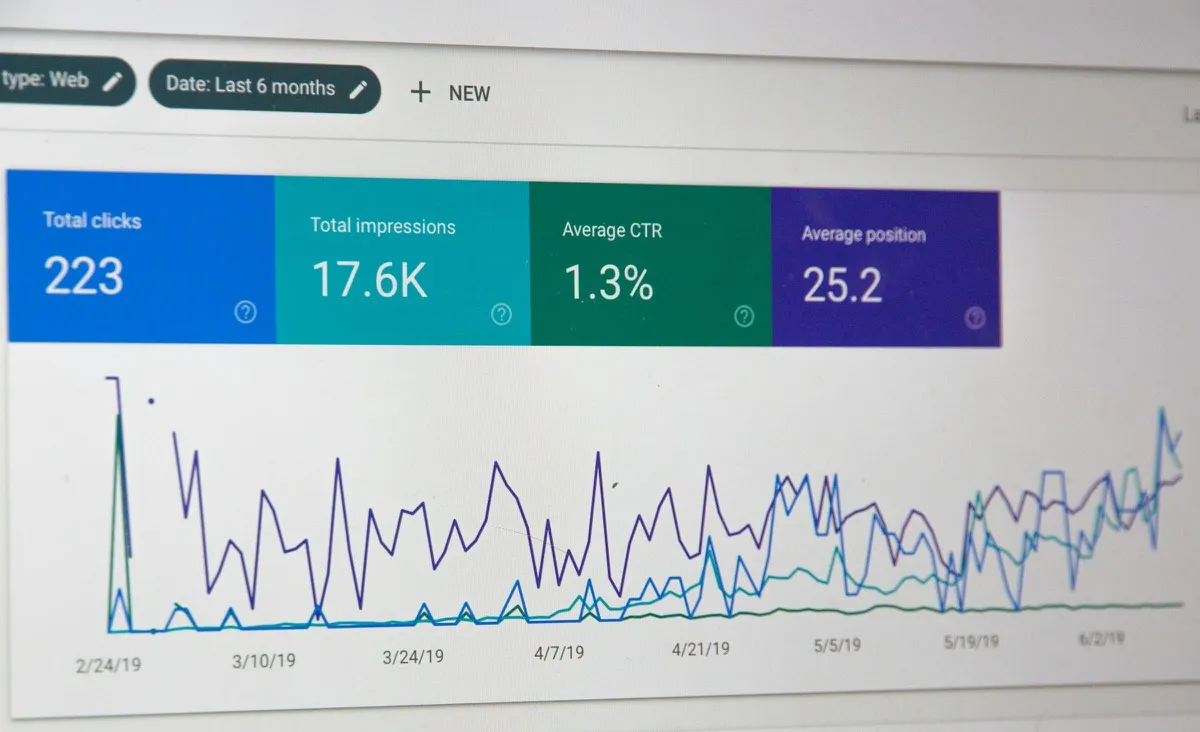

- PageSpeed Insights (pagespeed.web.dev) — Core Web Vitals et performance

- Google Search Console — Indexation, erreurs, couverture

- Rich Results Test — Validité des données structurées

- Screaming Frog (version gratuite jusqu'à 500 URLs) — Analyse complète du site

- Ahrefs Webmaster Tools (gratuit) — Audit technique basique

Si le diagnostic révèle plus de 2-3 problèmes, un audit technique professionnel vaut l'investissement. Corriger ces erreurs peut doubler votre trafic organique en quelques mois.

Et si le diagnostic révèle que le problème est plus profond — architecture obsolète, code non optimisable, technologie dépassée — c'est peut-être le signe qu'une refonte s'impose.

Notre approche SEO technique

Chez Nexel Dev, le SEO technique est intégré dans chaque projet dès la conception :

- Architecture Next.js — rendu serveur, métadonnées dynamiques, sitemaps automatiques

- Performance native — score PageSpeed 85-100 sur tous nos sites

- Données structurées — schemas JSON-LD pour chaque type de page

- Structure d'URLs — propres, hiérarchiques, pérennes

- Monitoring continu — via notre offre de maintenance et optimisation

On ne se contente pas de construire un site rapide. On construit un site que Google aime indexer et classer.

Votre site a des problèmes techniques invisibles qui freinent votre référencement ? Contactez-nous pour un audit SEO technique — on identifie les blocages et on vous donne un plan d'action priorisé pour y remédier.

Questions fréquentes

Les réponses aux questions que nos lecteurs posent le plus souvent.